英伟达AI工厂揭秘:七芯合一,60EFLOPS算力怪兽如何炼成

从GPU到AI工厂:英伟达的算力革命

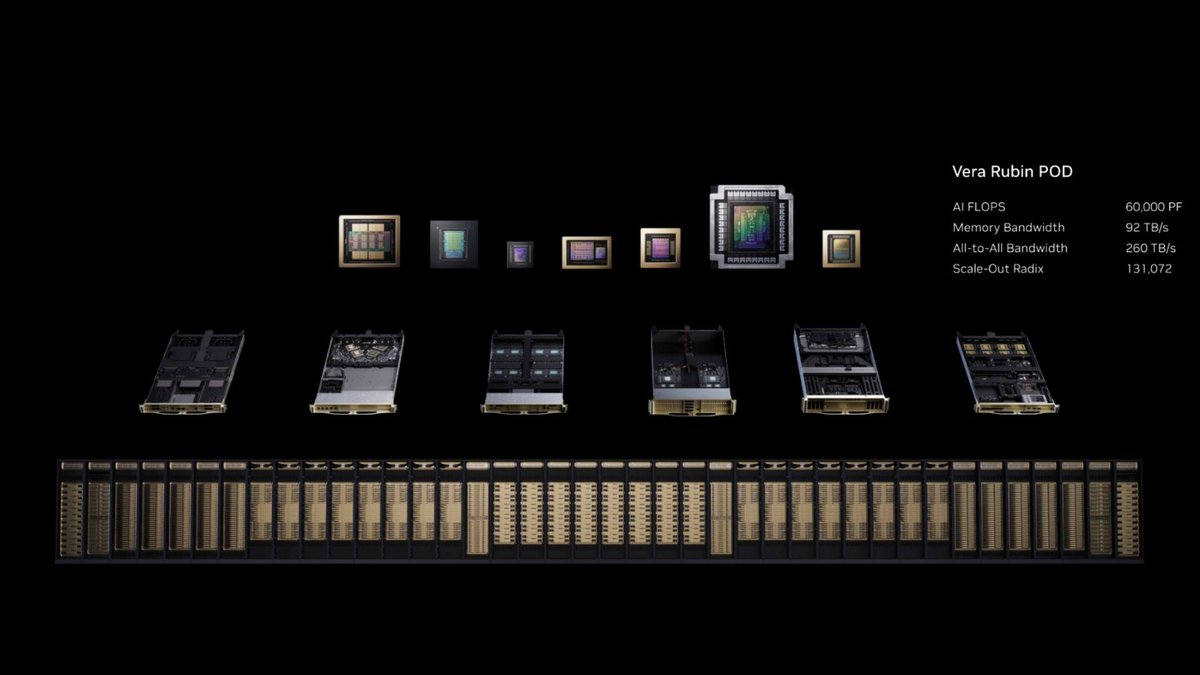

当其他公司还在为单颗芯片的性能较劲时,英伟达已经悄悄把游戏规则升级到了“工厂级”。在GTC 2026大会上,黄仁勋没有像往常那样重点展示某款GPU,而是端出了一整套名为Vera Rubin的AI基础设施解决方案——由七款芯片组成的完整硅栈,能够构建从单个机架到40机架规模的AI工厂POD,最高提供60EFLOPS的恐怖算力。

七芯演义:各司其职的AI流水线

这七款芯片可不是简单的堆砌,而是经过精心设计的AI流水线。想象一下,你要训练一个万亿参数的大模型,这就像是在建造一座摩天大楼,需要不同的专业团队协同作业。

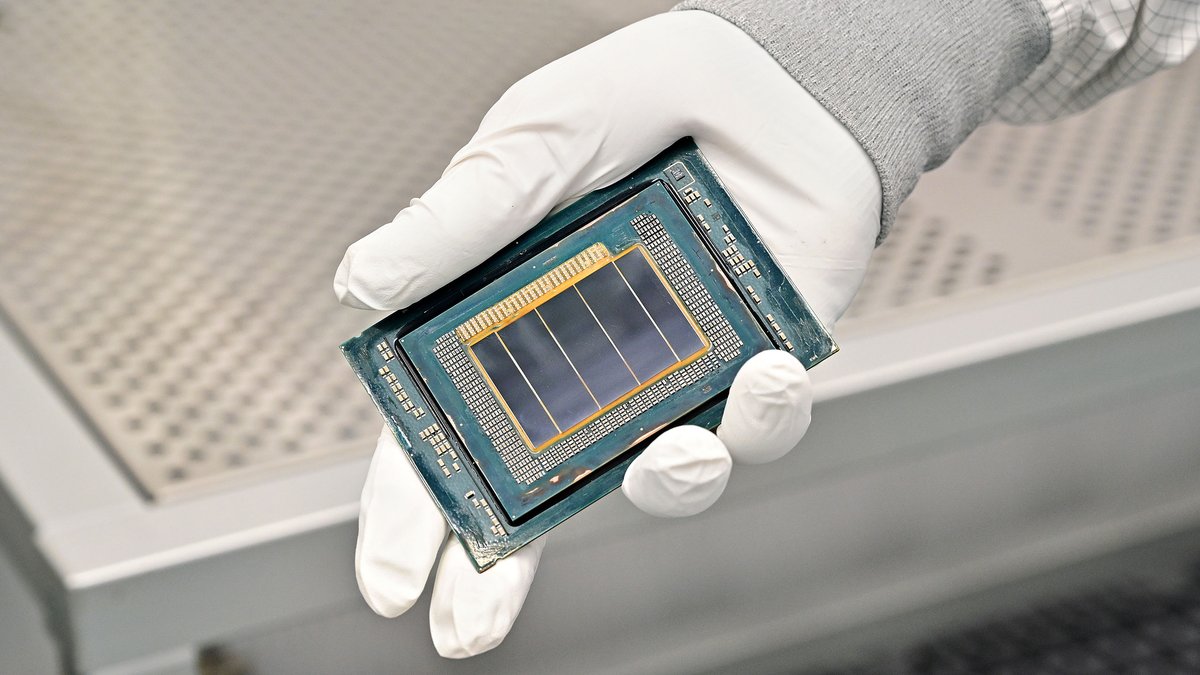

Rubin GPU是这里的主力建筑队,基于台积电3nm工艺打造,采用双芯片设计,集成了3360亿个晶体管。它配备了288GB的HBM4内存,带宽达到22TB/s,在推理和训练性能上分别比上一代Blackwell提升了5倍和3.5倍。在旗舰的NVL72机架中,72颗Rubin GPU通过NVLink 6连接,可以像单个加速器一样工作,训练MoE模型所需的GPU数量仅为Blackwell的四分之一。

Vera CPU则是这个工地的总指挥,这是英伟达首款从头设计的服务器CPU。它采用88个基于Arm架构的定制核心,支持空间多线程技术,最高可提供1.5TB的内存容量。Vera CPU通过NVLink-C2C与GPU连接,带宽是PCIe Gen6的7倍,专门负责调度任务、管理数据流和控制AI工作流程——简单说,它就是让所有硬件和谐共处的“大脑”。

最让人意外的是Groq 3 LPU的加入,这是英伟达去年200亿美元收购Groq的直接成果。如果说Rubin GPU是大容量仓库,那么Groq 3就是高速公路——每颗芯片虽然只有约500MB的SRAM,但带宽高达80TB/s。在推理任务中,Rubin GPU负责处理输入阶段的繁重计算,而Groq 3则专门负责输出阶段的低延迟解码,两者配合可以将推理能效提升35倍。

网络神经:让数据飞起来

有了强大的计算单元,如何让数据在芯片间、机架间高效流动就成了关键。英伟达为此设计了三款专用网络芯片:

- NVLink 6交换机负责机架内的互联,带宽是Blackwell的两倍

- BlueField-4 DPU专门处理数据预处理和卸载CPU负担

- Spectrum-5以太网交换机则负责机架间的数据交换

这种设计让整个系统像神经系统一样高效,数据可以在不同组件间无缝流动,不会出现“大脑发达四肢不协调”的尴尬局面。

行业冲击波:重新定义AI基础设施

Vera Rubin平台的推出,标志着AI基础设施正在从“卖硬件”向“卖解决方案”转变。对于企业用户来说,这意味着:

首先,部署门槛大幅降低。以前要构建大规模AI集群,需要自己整合GPU、CPU、网络设备,现在英伟达直接提供“交钥匙”方案,从单个机架开始就能获得完整功能。

其次,总拥有成本可能不升反降。虽然初期投入看起来不小,但考虑到性能提升和能效优化,训练同样规模模型所需的时间和电力成本都会显著下降。英伟达声称,对于万亿参数模型,Vera Rubin可以带来10倍的收入机会提升。

最后,这可能会加速AI应用的普及。当算力变得像水电一样容易获取时,更多中小企业和研究机构将能够负担得起大规模AI训练,推动整个生态的繁荣。

写在最后:算力军备竞赛的新阶段

英伟达这次亮出的不只是几款芯片,而是一整套重新定义行业的标准。从单个GPU到完整AI工厂,这种转变有点像从卖零件到卖整车的进化。对于竞争对手来说,这无疑是个巨大的挑战——你不仅要追赶单芯片性能,还要构建完整的生态系统。

不过,对于AI开发者来说,这绝对是个好消息。当算力瓶颈被打破,我们可以期待更多惊艳的AI应用诞生。毕竟,在AI的世界里,算力就是想象力——而现在,想象力的天花板又被抬高了一大截。