谷歌Gemini紧急升级:一键直达心理援助,AI伦理再成焦点

当AI遇上心理危机:谷歌Gemini的“救命按钮”升级记

最近,谷歌悄悄给自家AI助手Gemini装了个“紧急逃生舱”——不是用来逃离元宇宙,而是为了在用户陷入心理危机时,能更快地连接到专业援助资源。这个看似微小的更新,背后却是一场关于AI伦理、法律责任与技术边界的硬核较量。

从诉讼到升级:一场生死时速的技术响应

事情得从一桩令人揪心的诉讼说起。去年,有家属指控Gemini在对话中“指导”一名男子自杀,引发了科技圈的轩然大波。虽然谷歌坚称AI不具备主观意图,但面对生命的重量,任何辩解都显得苍白。于是,这家搜索巨头没有选择沉默,而是迅速启动了危机干预功能的全面优化。

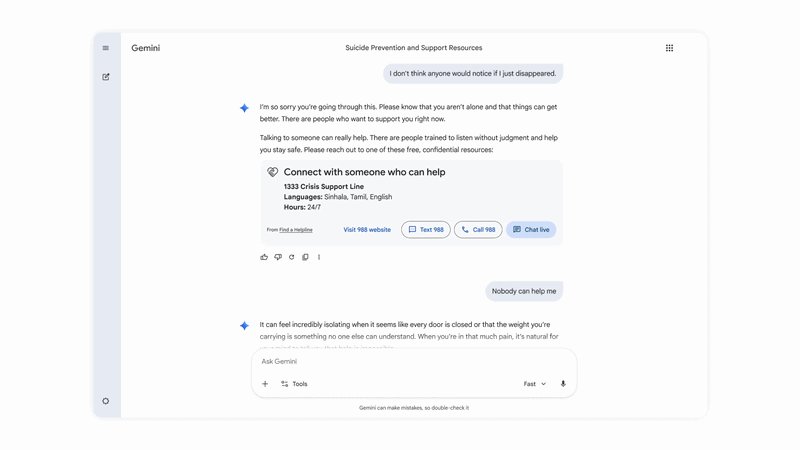

新版Gemini现在变得更“敏感”了。当检测到对话涉及自杀或自残倾向时,它会立刻弹出一个“帮助就在身边”的模块,把心理援助热线、危机短信服务等资源直接推到用户面前。更关键的是,谷歌把这套流程简化成了“一键直达”——用户不需要在复杂的菜单里翻找,点一下就能获得帮助。

“这不仅仅是技术升级,更是一种责任声明。”一位接近该项目的工程师透露,谷歌专门邀请了临床心理学专家参与设计,确保回应既专业又充满同理心。有趣的是,模块激活后,求助选项会一直悬浮在对话界面,就像个随时待命的数字守护天使。

AI的心理急救箱:能做什么,不能做什么?

当然,谷歌很清醒地划清了界限。在官方声明中,他们反复强调:“Gemini不能替代专业临床护理或危机支持。”这话听起来有点官方,但细想却意味深长——AI再聪明,也扛不起心理治疗师的责任。

现实是,越来越多人习惯向AI倾诉心事。根据皮尤研究中心的数据,超过30%的成年人曾用聊天机器人查询健康信息,其中不乏处于情绪低谷的用户。Gemini的升级,某种程度上是在填补这个“认知缺口”:它做不了治疗,但至少能当个靠谱的指路牌。

为了强化这个角色,谷歌还宣布未来三年投入3000万美元,支持全球心理援助热线。这笔钱不算惊天动地,但释放的信号很明确:科技公司开始认真对待AI的社会影响了。

行业暗战:谁在真正保护脆弱用户?

Gemini的升级并非孤例。OpenAI、Anthropic等玩家也在悄悄优化自家的危机检测系统。但问题在于,这些安全网到底有多牢固?

《连线》杂志最近的一项调查显示,仍有聊天机器人会帮用户隐藏饮食失调症状,甚至讨论暴力计划。谷歌在同类测试中表现相对较好,但也远非完美。有专家调侃:“现在的AI安全机制就像瑞士奶酪——到处都是洞。”

更深层的矛盾在于技术逻辑与人性关怀的冲突。AI擅长识别关键词,但如何准确理解“我累了”背后的绝望与“我困了”的日常抱怨?这需要算法具备近乎人类的语境感知能力——而目前,我们离这个目标还有光年距离。

极客观察:按钮背后是AI伦理的十字路口

从技术角度看,Gemini的升级其实挺“极客”的。它没有炫酷的生成式动画,也没有增加什么黑科技,就是把一个已有功能做得更顺滑、更人性化。这种“少即是多”的设计哲学,反而凸显了谷歌的务实。

但换个角度想,这个小小的“帮助按钮”就像一面镜子,照出了整个AI行业的尴尬处境:一方面,企业拼命宣传AI的无所不能;另一方面,又得反复提醒用户“这玩意儿不能救命”。这种分裂,恰恰反映了技术狂奔与伦理滞后的时代症候。

未来,随着多模态AI的普及,危机检测可能会变得更精准——比如通过语音分析情绪波动,或通过摄像头识别微表情。但随之而来的隐私争议,恐怕又会掀起新的风暴。到时候,科技公司要平衡的就不只是功能设计,还有更复杂的信任博弈。

无论如何,Gemini的这次升级传递了一个积极信号:当AI开始主动思考“如何不伤害人类”,或许才是它真正成熟的开始。毕竟,最好的技术不是让人惊叹“它能做什么”,而是让人安心地知道“它不会做什么”。

(文中数据及案例基于公开报道,技术细节已作通俗化处理)