英伟达Vera Rubin芯片紧急升级,内存带宽飙升70%硬刚AMD MI455X

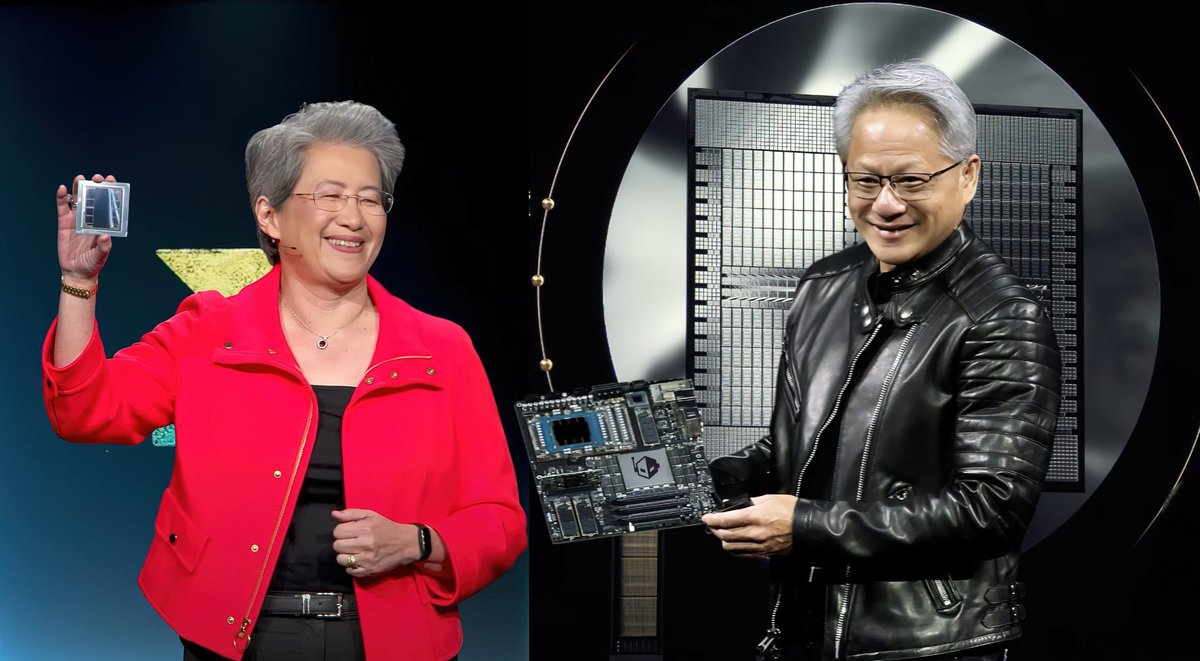

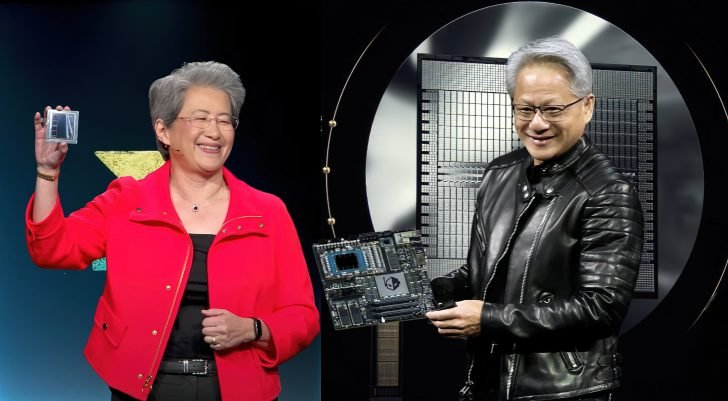

AI芯片战场硝烟再起:英伟达的“紧急升级”与AMD的步步紧逼

如果你以为AI芯片的竞争只是参数表上的数字游戏,那可就大错特错了。最近,英伟达上演了一出精彩的“临阵换将”戏码——原本在2025年3月公布的Vera Rubin平台内存带宽还停留在13TB/s,到了9月就变成了22.2TB/s,足足提升了70%!这可不是什么常规的产品迭代,而是一场针对AMD Instinct MI455X芯片的针对性反击。

内存带宽:AI芯片的“高速公路”之争

要理解这场升级的意义,得先明白内存带宽在AI芯片中的重要性。想象一下,AI模型就像一辆超级跑车,而内存带宽就是它行驶的高速公路。带宽越大,数据在处理器和内存之间流动的速度就越快,模型训练和推理的效率就越高。特别是在当前“智能体AI”爆发的时代,大模型需要处理海量实时数据,内存带宽直接决定了AI系统的“思考速度”。

AMD这次祭出的MI455X芯片,凭借19.6TB/s的内存带宽一度领先。这个数字怎么来的?AMD采用了12层堆叠的HBM4内存技术,相当于在有限的空间里建起了12层高的“数据公寓”,自然能容纳更多数据流量。而英伟达的应对策略相当“极客”——他们选择了8层堆叠的窄接口方案,但通过“超频”内存引脚速度到11Gbps,硬是把带宽拉到了22.2TB/s。这就像是用更少的车道,但让每辆车都开得更快。

技术升级背后的市场博弈

这场升级绝非偶然。据行业分析机构SemiAnalysis透露,英伟达此次规格调整直接针对的是超大规模云服务商的采购需求。这些“云巨头”们正在疯狂部署智能体AI系统,对内存带宽的要求近乎苛刻。英伟达如果不及时跟进,很可能在即将到来的CES 2026上被AMD抢走风头。

有趣的是,这次升级的时间线相当紧凑:

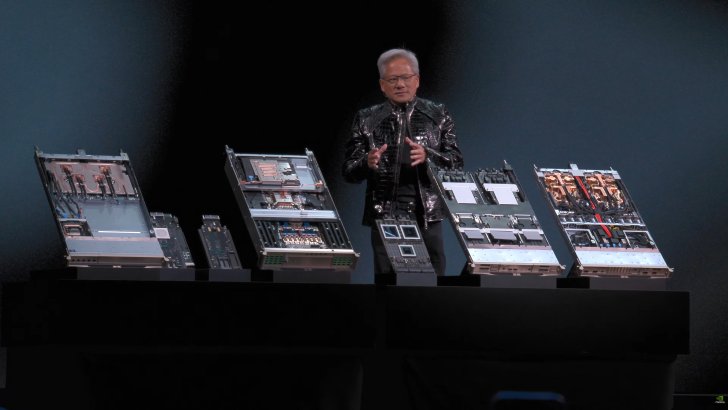

- 2025年3月:黄仁勋首次公布Vera Rubin平台,内存带宽13TB/s

- 2025年9月:英伟达高管Ian Buck宣布规格调整

- 2025年底:最终确定22.2TB/s的VR200 NVL72规格

这种“边造边改”的做法在芯片行业相当罕见,足见竞争之激烈。有业内人士调侃:“这感觉就像是考试前一天晚上疯狂刷题,只为比同桌多考10分。”

行业影响:用户最终受益的“神仙打架”

对于普通开发者和企业用户来说,这场竞争其实是件好事。更强大的硬件意味着:

- 更快的模型训练速度,节省时间和成本

- 更复杂的AI应用成为可能

- 云计算服务性价比可能提升

不过,技术爱好者们更关心的是:这种“军备竞赛”会持续多久?目前来看,双方都在HBM4内存技术上做文章,但未来的竞争可能会延伸到芯片架构、能效比、软件生态等多个维度。毕竟,AMD在CPU+GPU协同计算方面有传统优势,而英伟达的CUDA生态依然牢不可破。

这场AI芯片的“巅峰对决”才刚刚开始。随着Vera Rubin和MI455X陆续量产,2026年的数据中心市场很可能迎来新一轮洗牌。到时候,我们或许会看到更多“真香”的定价和“黑科技”的功能——毕竟,有竞争的市场,才是好市场。

唯一可以确定的是,无论谁胜谁负,AI技术的发展速度都会被这场竞赛再次推上一个新台阶。而对于我们这些围观群众来说,准备好爆米花,看两大芯片巨头如何“秀肌肉”,本身就是一场精彩的科技大戏。