英伟达Vera Rubin AI服务器今夏首秀,超大规模客户先尝鲜

AI服务器新王者今夏登场,英伟达Vera Rubin首批发货锁定超大规模客户

上周,广达电脑副总裁杨麒令在1月15日的公司庆典活动上透露了一个重磅消息:英伟达代号“Vera Rubin”的AI服务器硬件,预计将在今年8月迎来首次发货。这比业界此前预期的2026年下半年量产时间表,足足提前了半年多。不过,杨麒令也泼了盆冷水——初期发货主要面向超大规模客户,大规模部署和显著营收贡献还得再等等。

从Grace Blackwell到Vera Rubin:一场架构的“平滑升级”?

目前,大多数客户还在基于英伟达当前代的Grace Blackwell GB200和GB300平台运行AI业务。但杨麒令认为,得益于共同的架构特性,向Vera Rubin平台的过渡会比以往更容易。这话听起来挺乐观,但行业观察家们却指出了潜在挑战:从Grace Blackwell的chiplet(小芯片)设计,转向Vera Rubin的先进封装技术,可不是简单的“换壳”游戏。

简单来说,chiplet就像乐高积木,把不同功能的小芯片拼在一起,灵活又经济;而先进封装则更像精密的集成电路,追求更高性能和更小体积。这种转变,意味着客户在软件优化、散热管理乃至数据中心布局上,可能都需要重新适应。不过,英伟达显然信心满满,在今年CES上就宣布Vera CPU和Rubin GPU已启动全面生产,这速度,简直比双十一抢购还快。

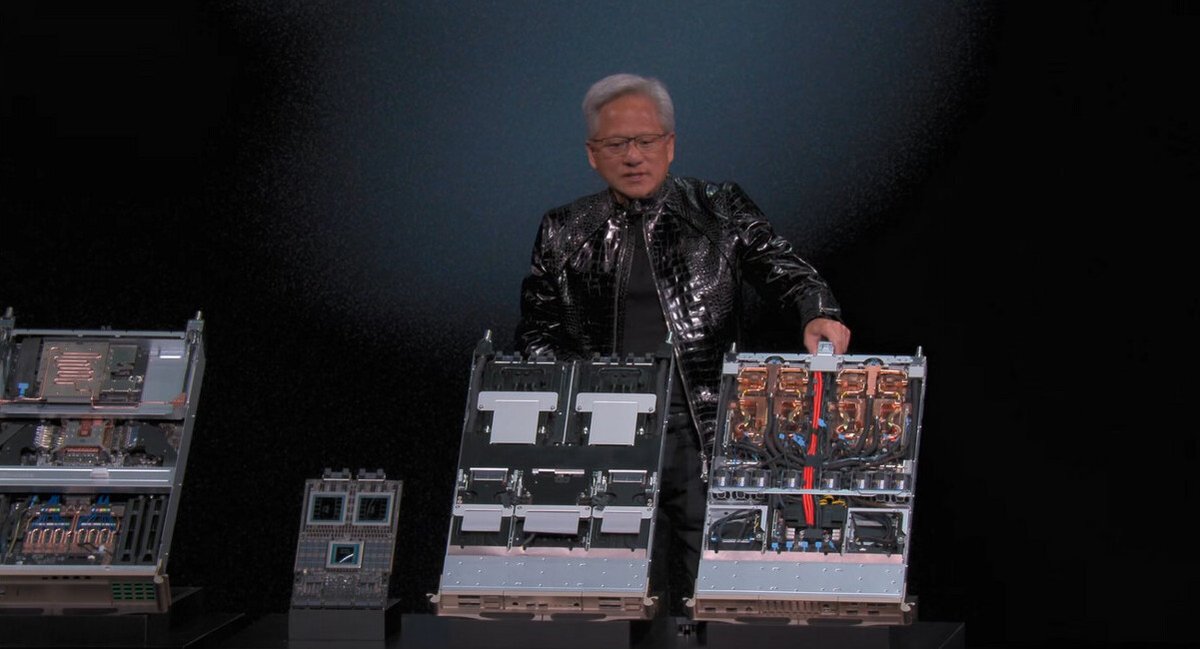

Vera Rubin SuperCluster:AI算力的“巨无霸”套餐

Vera Rubin平台的核心亮点之一,是NVL72 SuperCluster——这款被归类为顶级机架级系统的“巨无霸”,专为超大规模AI训练和推理设计。去年,英伟达还预览了更大的NVL144变体,但CPX平台似乎离发布还有段距离。用极客的话说,这就像是从“豪华套餐”升级到了“全家桶”,算力密度和能效比有望再上新台阶。

有趣的是,去年10月中旬的一份报告显示,某制造合作伙伴还在权衡“2026年量产”的宽松时间窗口。现在看来,英伟达的进度条明显拉快了,这或许得益于其在AI芯片领域的绝对话语权,以及客户对更高算力的饥渴需求。毕竟,在AI竞赛白热化的今天,谁先拿到最新硬件,谁就可能在新一轮模型训练中抢占先机。

行业影响:超大规模客户的“特权”,中小玩家还得排队?

首批发货瞄准超大规模客户,这策略并不意外。谷歌、微软、亚马逊这些云计算巨头,一直是英伟达AI芯片的最大买家,它们的数据中心规模和对尖端技术的消化能力,足以支撑早期产品的部署和优化。但对中小型企业和研究机构来说,可能得耐心等等了——毕竟,新平台的价格和生态成熟度,都是需要考虑的现实因素。

从行业角度看,Vera Rubin的提前出货,可能会进一步巩固英伟达在AI硬件市场的领先地位。竞争对手如AMD和英特尔,虽然也在加速追赶,但在生态和客户黏性上,仍面临不小挑战。不过,这也提醒我们:AI算力竞赛,不仅是芯片的比拼,更是软件栈、开发者工具和行业解决方案的全方位较量。

结语:AI硬件迭代加速,但落地仍需时间

总的来说,Vera Rubin的即将登场,标志着AI服务器硬件又迈入了新阶段。它的先进封装技术和机架级设计,有望为超大规模AI应用带来更高效的算力支持。但正如广达高管所言,大规模部署和营收贡献不会一蹴而就——技术过渡、成本控制和实际应用场景的磨合,都是需要时间的。

对于普通开发者或企业用户来说,或许不必急于“追新”。当前代的Grace Blackwell平台依然强大,且生态更为成熟。而Vera Rubin的逐步普及,将取决于英伟达能否在性能、价格和易用性上找到最佳平衡点。无论如何,这场AI硬件的进化之旅,才刚刚进入高潮。我们不妨拭目以待,看这位“新王者”如何改写游戏规则。