AI伦理战升级:法官叫停五角大楼封杀令,Anthropic反击成功

一场关于AI灵魂的法庭对决

当五角大楼的封杀令遇上硅谷的AI伦理红线,这场科技与权力的碰撞在加州北区法院迎来了戏剧性转折。法官丽塔·林的一纸临时禁令,不仅暂时解除了对Anthropic的“供应链风险”封杀,更在判决书中写下了那句掷地有声的评语:“惩罚Anthropic……是典型的违宪报复行为。”

封杀令背后的AI伦理拉锯战

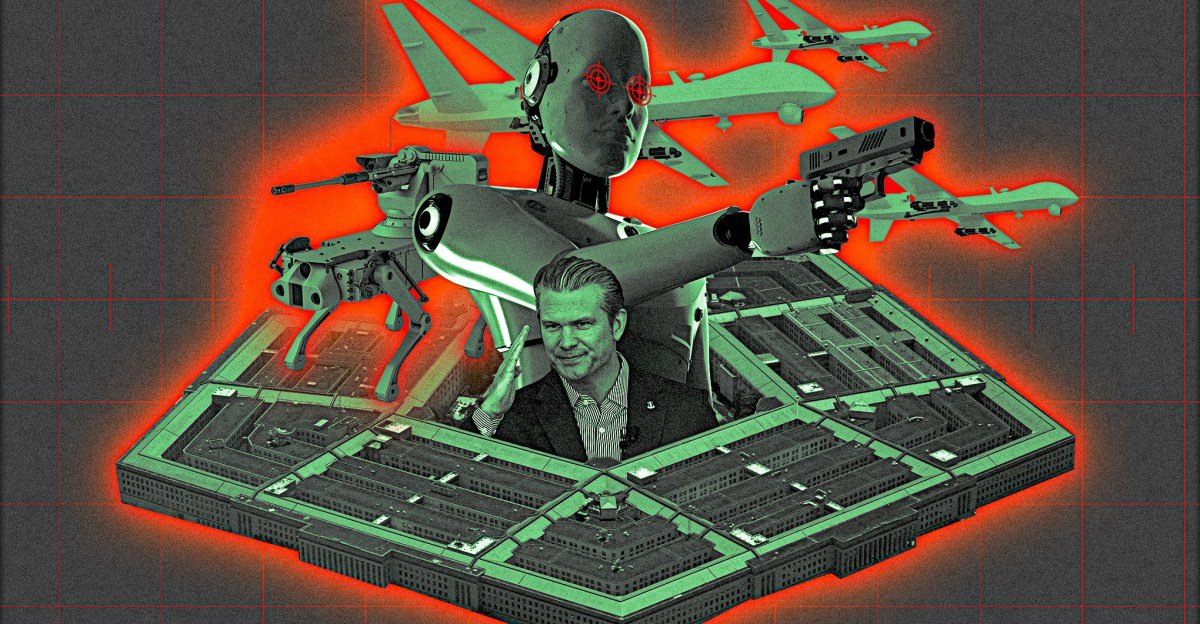

这场风波始于今年1月9日,美国国防部长皮特·赫格塞斯的一份备忘录。文件要求所有AI服务采购合同必须在180天内加入“任何合法用途”条款,这直接触动了Anthropic的神经。作为ChatGPT最强竞争对手之一的创造者,Anthropic在谈判中划出了两条不可逾越的红线:禁止将Claude AI用于国内大规模监控和致命性自主武器系统。

“这就像让AI学会开枪却不让人类扣扳机,”一位硅谷观察家如此形容这场博弈的微妙之处。Anthropic坚持其AI助手Claude不应成为“杀人机器”或“监控工具”,而五角大楼则认为军事指挥官才有权决定AI的安全使用范围。

法庭上的“第一修正案”攻防

随着谈判陷入僵局,事态迅速升级。五角大楼将Anthropic列入“供应链风险”黑名单,这招商业核武器几乎能让一家科技公司瞬间失去所有政府订单。但Anthropic的反击同样犀利——他们以“第一修正案权利受侵害”为由将政府告上法庭。

法官林在听证会上展现了法律人的睿智:“我的角色不是判断谁在这场辩论中正确……问题在于政府是否在行使权力时违反了法律。”她指出,五角大楼完全可以选择不使用Claude,转而寻找更“顺从”的AI供应商,但不能因为Anthropic通过媒体表达立场就实施报复。

AI军事化:科技公司的“不作恶”2.0

这场官司背后,是硅谷正在经历的价值观重塑。当AI技术从实验室走向战场,科技巨头们不得不面对一个残酷的问题:我们的技术底线在哪里?

- 技术层面:Claude采用的“宪法AI”训练方法,本身就内置了伦理约束机制

- 商业层面:失去政府合同可能影响短期营收,但坚守伦理可能赢得长期信任

- 行业影响:OpenAI、xAI、谷歌等公司都在密切关注此案,这将成为AI军事化应用的判例

有趣的是,在Anthropic与五角大楼对峙期间,其他AI公司却悄悄加快了与军方的合作谈判。“这就像一场AI版的军备竞赛,”业内人士调侃道,“只不过竞赛项目是谁更能守住道德底线。”

临时胜利后的漫长道路

虽然获得了临时禁令,但Anthropic发言人丹妮尔·科恩在声明中保持了谨慎的乐观:“我们的重点仍然是与政府建设性合作,确保所有美国人从安全可靠的AI中受益。”这句话的潜台词很明确——官司要打,生意也要做。

法官林的禁令将在七天后生效,但这只是漫长司法程序的第一步。本案的核心争议——政府能否因企业公开表达伦理立场而实施商业惩罚——将在后续审理中见分晓。无论结果如何,这场官司已经给AI行业上了一堂生动的“商业伦理与宪法权利”大师课。

在AI技术日新月异的今天,科技公司不仅要思考“我们能做什么”,更要思考“我们该做什么”。当算法开始涉及生死决策,这场发生在法庭和谈判桌之间的AI伦理战,或许才刚刚拉开序幕。